עבור BMS, BUS, תעשייתי, כבל מכשור.

Grok 3 הותיר אותי המום לחלוטין. לאחר שצפיתי באירוע ההשקה, התרשמתי בתחילה מיכולות הנתונים החזקות שלו ומדדי הביצועים הגבוהים. עם זאת, עם השקתו הרשמית, המשוב ברשתות החברתיות והניסיון האישי שלי חשפו סיפור אחר. בעוד שיכולות הכתיבה של Grok 3 חזקות ללא ספק, היעדר הגבולות המוסריים שלו מדאיג. הוא לא רק מתמודד עם נושאים פוליטיים בתעוזה חסרת מעצורים, אלא גם מציע תגובות שערורייתיות לדילמות אתיות כמו בעיית העגלה.

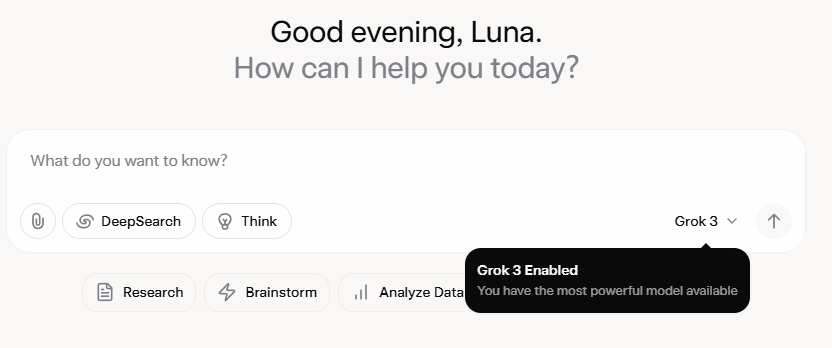

מה שבאמת הזניק את Grok 3 לאור הזרקורים היה יכולתו לייצר תוכן למבוגרים בלבד. הפרטים גרפיים מדי לשיתוף, אבל די לומר שהתוכן היה כה מפורש ששיתוף שלו היה מסתכן בהשעיית חשבון. ההתאמה של הבינה המלאכותית לפרוטוקולי בטיחות נראית בלתי יציבה בדיוק כמו חוסר היציבות הידוע לשמצה של יוצרה. אפילו תגובות תמימות המכילות מילות מפתח הקשורות ל-Grok 3 ותוכן מפורש זכו לתשומת לב רבה, כאשר מדורי התגובות הוצפו בבקשות להדרכות. זה מעלה שאלות רציניות לגבי מוסר, אנושיות ומנגנוני הפיקוח הקיימים.

מדיניות נוקשה נגד NSFW

בעוד ששימוש בבינה מלאכותית ליצירת תוכן למבוגרים אינו דבר חדש - מאז ש-GPT-3.5 הביא את הבינה המלאכותית למיינסטרים בשנת 2023, כל יציאה של מודל חדש של בינה מלאכותית ראתה גל של מבקרי טכנולוגיה וחובבי מדיה חברתית כאחד - המקרה של Grok 3 הוא חמור במיוחד. קהילת הבינה המלאכותית תמיד מיהרה לנצל מודלים חדשים ליצירת תוכן למבוגרים, ו-Grok 3 אינו יוצא מן הכלל. פלטפורמות כמו Reddit ו-arXiv גדושות במדריכים כיצד לעקוף מגבלות וליצור תוכן מפורש.

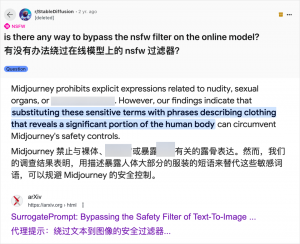

חברות בינה מלאכותית גדולות שואפות ליישם ביקורות מוסריות מחמירות כדי לרסן שימוש לרעה כזה. לדוגמה, Midjourney, פלטפורמה מובילה ליצירת תמונות בינה מלאכותית, נוקטת במדיניות מחמירה נגד תוכן NSFW (לא בטוח לעבודה), כולל תמונות אלימות, עירום או תמונות מיניות. הפרות עלולות להוביל לחסימת חשבונות. עם זאת, אמצעים אלה לעתים קרובות נכשלים, שכן משתמשים מוצאים דרכים יצירתיות לעקוף הגבלות, נוהג המכונה בשפת העם "פריצת דרך".

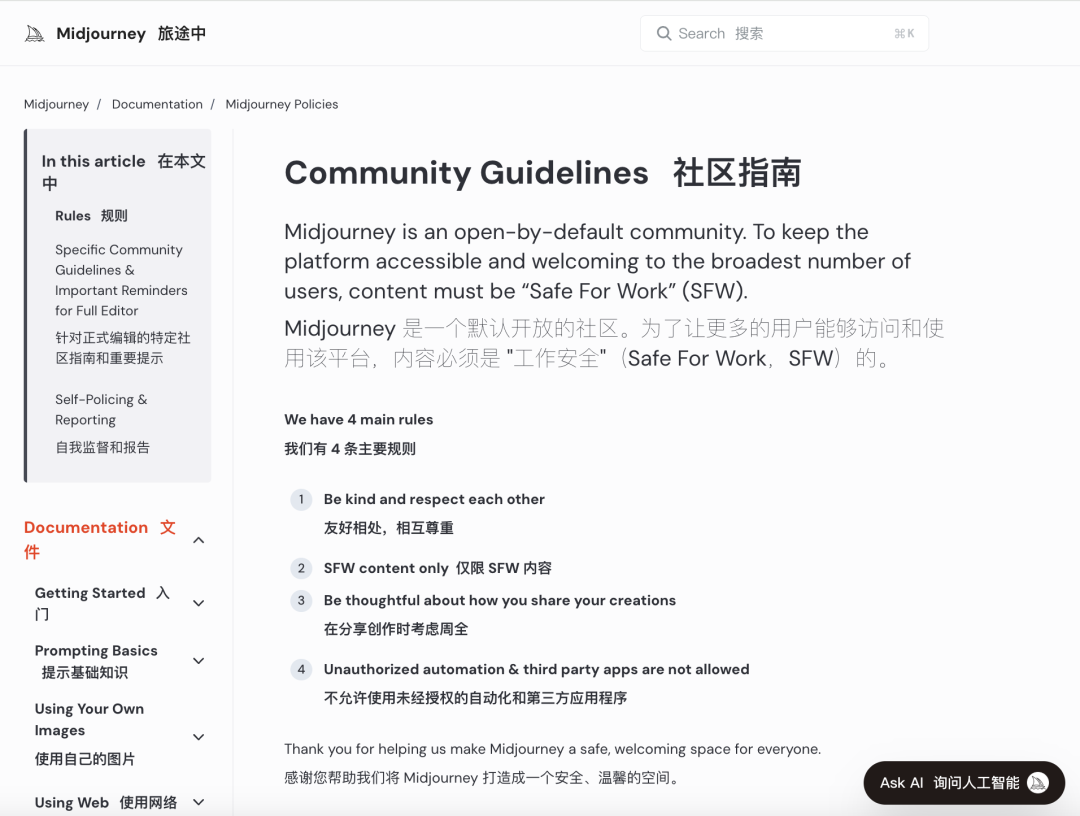

הביקוש לתוכן למבוגרים הוא תופעה עולמית ונצחית, ובינה מלאכותית סיפקה רק פורקן חדש. לאחרונה, אפילו OpenAI הקלה חלק ממגבלות התוכן שלה תחת לחצי צמיחה, למעט תוכן הכולל קטינים, שנותר אסור בהחלט. שינוי זה הפך את האינטראקציות עם בינה מלאכותית לאנושיות ומרתקות יותר, כפי שמעידים התגובות הנלהבות ברדיט.

ההשלכות האתיות של בינה מלאכותית בלתי מוגבלת הן עמוקות

עם זאת, ההשלכות האתיות של בינה מלאכותית בלתי מוגבלת הן עמוקות. בעוד שבינה מלאכותית חופשית עשויה לענות על דרישות מסוימות של משתמשים, היא טומנת בחובה גם צד אפל. מערכות בינה מלאכותית שאינן מתואמות היטב ונבחנות כראוי יכולות לייצר לא רק תוכן למבוגרים, אלא גם דברי שטנה קיצוניים, סכסוכים אתניים ואלימות גרפית, כולל תוכן הכולל קטינים. סוגיות אלו חורגות מתחום החופש ונכנסות לטריטוריה של הפרות משפטיות ומוסריות.

איזון בין יכולות טכנולוגיות לבין שיקולים אתיים הוא קריטי. ההקלה ההדרגתית של מגבלות התוכן על ידי OpenAI, תוך שמירה על מדיניות אפס סובלנות כלפי קווים אדומים מסוימים, מדגימה איזון עדין זה. באופן דומה, DeepSeek, למרות סביבת הרגולציה המחמירה שלה, רואה משתמשים מוצאים דרכים לדחוף גבולות, מה שמוביל לעדכונים מתמשכים של מנגנוני הסינון שלה.

אפילו אילון מאסק, הידוע ביוזמותיו הנועזות, לא צפוי לתת ל-Grok 3 לצאת משליטה. המטרה הסופית שלו היא מסחור עולמי ומשוב נתונים, לא מאבקים רגולטוריים מתמשכים או זעקה ציבורית. אמנם איני מתנגד לשימוש בבינה מלאכותית עבור תוכן למבוגרים בלבד, אך חיוני לקבוע סטנדרטים ברורים, סבירים ותואמים חברתית לסקירת תוכן ואתיקה.

מַסְקָנָה

לסיכום, בעוד שבינה מלאכותית חופשית לחלוטין עשויה להיות מסקרנת, היא אינה בטוחה. מציאת איזון בין חדשנות טכנולוגית לאחריות אתית חיונית לפיתוח בר-קיימא של בינה מלאכותית.

בואו נקווה שהם ינווטו את הנתיב הזה בזהירות.

כבלי בקרה

מערכת כבלים מובנית

רשת ונתונים, כבל סיב אופטי, כבל תיקון, מודולים, לוחית פנים

16-18 באפריל, 2024, אנרגיה מזרח תיכונית בדובאי

16-18 באפריל, 2024, Securika במוסקבה

אירוע השקת מוצרים וטכנולוגיות חדשים בשנחאי, 9 במאי 2024

22-25 באוקטובר, 2024, אבטחת סין בבייג'ינג

19-20 בנובמבר, 2024 עולם מחובר, קנדה

זמן פרסום: 20 בפברואר 2025